La première moitié de l’année est désormais derrière nous et c’est certainement le moment idéal pour faire le point sur les différents événements SEO qui ont émaillé ces six premiers mois de l’année 2013.

La première moitié de l’année est désormais derrière nous et c’est certainement le moment idéal pour faire le point sur les différents événements SEO qui ont émaillé ces six premiers mois de l’année 2013.

Que s’est-il passé en SEO de janvier à juillet 2013 ? Que faut-il en retenir ? Voilà des questions auxquelles nous allons tenter d’apporter un début de réponse en passant des vidéos de Matt Cutts aux mises à jour de Panda et Penguin en passant par l’avenir du SEO.

Les mises à jour de Google

Si 2011 et 2012 ont marqué les esprits de référenceurs avec les arrivées des algorithmes de Google (les désormais familiers Panda et Penguin pour ceux qui les auraient oubliés), la première moitié de l’année 2013 s’est inscrite dans la même lignée avec le même objectif pour le moteur de recherche le plus populaire de la planète : améliorer les résultats de recherche et nettoyer les SERPs des sites spammy et aux systèmes de liens litigieux.

Conséquences de cet objectif (qui n’a pas été atteint selon bon nombre de spécialistes dans le domaine) : 3 mises à jour de Google Panda ont été effectuées (le 22 janvier, le 15 mars et le 18 juillet – retrouvez-les toutes ici) et surtout Penguin 2.0 a été déployé mondialement en touchant bon nombre de sites web comme le démontre les résultats d’un récent sondage réalisé par Seoisnotacrime.

Les conseils et avertissements de Matt Cutts

A côté de ces mises à jour qui démontrent les efforts de Google pour une SERPs plus propre (même si ce n’est pas toujours le cas), nous retiendrons de cette première moitié d’année que Google a communiqué abondamment via des vidéos réalisées par l’intermédiaire de Matt Cutts, chef de son équipe antispam. Cependant, force a été de constater que les conseils de l’ami Matt n’ont pas toujours été des plus instructifs puisqu’il y raconte parfois tout et son contraire.

Parmi toutes les vidéos qui ont été publiée par Matt Cutts depuis le début d’année, une a particulièrement retenu notre attention :

Dans cette vidéo, Matt Cutts faisait le point sur ce que l’on pouvait attendre de Google en termes de SEO pour les prochains mois et force est de constater que Google se tient plutôt bien à ce programme que vous pouvez retrouver ici.

L’avenir du SEO

L’évolution du SEO – Crédit : www.dkssystems.comAvec toutes les données que nous avons reçues de la part de Google ces derniers mois, le SEO ne peut aller que dans une seule direction : il doit être toujours plus naturel. Pourtant, cela ne veut pas dire pour autant que le SEO est mort comme certains le prétendent. Plutôt que cela, nous auront plutôt tendance à dire que le SEO est en pleine mutation depuis plusieurs mois et qu’il faut s’adapter à ces évolutions pour préserver ses sites et continuer à offrir de la visibilité à ses clients.

Pour vous convaincre que Google et les entreprises auront toujours besoin du travail des référenceurs, je vous conseille de lire cet article paru chez Miss Seo Girl dans lequel Carine explique pourquoi le SEO n’est pas mort.

Depuis que Penguin 2.0 a été déployé à travers le monde, beaucoup de spécialistes du référencement ont adapté leurs techniques et leurs stratégies de Search Engine Optimization (SEO).

Durant le SMX Advanced, Matt Cutts a discuté avec Eric Enge et ce dernier a publié l’interview du chef de l’équipe anti-spam de Google sur son site web. Le sujet de cette interview se concentrait essentiellement sur le link building et ce qui n’était pas bon de faire en SEO aujourd’hui (via Searchengineland)

Comme on pouvait s’en douter, dans les grandes lignes, Matt Cutts explique qu’il souhaiterait un monde où les spécialistes du link building penseraient d’abord au contenu et au site internet avant de se concentrer à la création de liens.

Voici quelques éléments clés qui sont ressortis de l’interview et qui méritent d’être mis en avant. Cependant, n’hésitez pas à aller lire l’interview complète ici.

1. Le link building n’est pas mauvais

Dans son interview, la première question d’Eric Enge consiste à demander à Matt Cutts si le link building est illégal. Réponse à laquelle le chef de l’équipe antispam de Google répond par la négative. En effet, seuls certains types de link building sont illégaux comme le piratage de blog par exemple.

Selon Matt Cutts, le problème vient également du fait que les gens essaient d’abord de faire des liens pour que leurs sites soient réussis. Cependant, il faut réfléchir dans un autre sens et il faut plutôt réaliser un superbe site qui donne envie de le partager et de créer du lien vers lui.

2. Les liens dans les communiqués de presse

Ils ne sont probablement pas pris en compte mais le but du communiqué de presse ne doit pas de vouloir faire un lien mais bien de gagner de la visibilité grâce aux personnes qui auront envie de relayer votre sujet.

3. La paternité du contenu

On entend régulièrement parler du fait que Google prend en compte du contenu plagié comme source originale de contenu. Si cela vous arrive et que vous voyez votre contenu sur d’autres sites, faites signe à Google que vous êtes la source originale.

Pour cela, assurez-vous de publier l’information avant les autres, utiliser la balise rel=canonical, faites un lien vers la source principale et servez-vous de l’authorship.

4. Les « guest post »

Les « guest post » sont de plus en plus tendances depuis que Penguin 2.0 a été déployé. Cette technique consiste à publier des articles et des informations sur d’autres sites ou blogs que le sien.

Le problème c’est que beaucoup d’internautes utilisent le guest post à mauvais escient. En effet, beaucoup de publications de ce type sont devenues des articles tels que ceux que l’on voit dans les annuaires.

5. Les liens

Les liens sont toujours le meilleur moyen de classer son contenu dans les meilleurs positions des SERPS.

Cet article fait écho d’une publication que nous avons trouvé sur Searchengineland en début de semaine. Dans son article (« 11 things we should never ever do in link building again« ), Erin Everhart démontre sa frustration par rapport à ce qu’elle voit en termes de stratégies de link-building. Et elle a raison. Un seul exemple : tout ceux qui ont un blog ou qui détiennent un site de communiqué de presse voient jours après jours des propositions de commentaires spam et d’articles dupliqués. Mais d’autres stratégies sont également à éviter, pour le bien de votre référencement.

Cet article fait écho d’une publication que nous avons trouvé sur Searchengineland en début de semaine. Dans son article (« 11 things we should never ever do in link building again« ), Erin Everhart démontre sa frustration par rapport à ce qu’elle voit en termes de stratégies de link-building. Et elle a raison. Un seul exemple : tout ceux qui ont un blog ou qui détiennent un site de communiqué de presse voient jours après jours des propositions de commentaires spam et d’articles dupliqués. Mais d’autres stratégies sont également à éviter, pour le bien de votre référencement.

Voici donc 7 choses à ne plus jamais faire dans une stratégie de link-building :

1. Privilégier la quantité à la qualité :

On l’a déjà dit et répété : il vaut mieux faire un bon lien que 25 liens peu intéressants. Parfois, il sera plus intéressant de faire un lien sur un site qui est lu par des centaines de personnes que faire 25 liens sur des sites web que personne ne va lire.

2. Proposer des articles en masse

Pourquoi les référenceurs et autres webmasters continuent-ils à proposer des dizaines de fois un même article sur différents sites web ? Quand on dit que le contenu est roi (« Content is King »), cela ne veut pas dire qu’il faut proposer ses articles partout !

Évitons donc donc ce genre de pratique, cela vous évitera de vous faire prendre par les algorithmes de Google et cela permettra à certains webmasters de ne plus perdre leur temps à vérifier les contenus de chaque article soumis.

3. Le content spinning

Dans la même vaine que l’erreur précédente : si c’est inutile de proposer plusieurs fois le même article, ça l’est tout autant de proposer des articles dont seuls quelques mots diffèrent. En effet, ce n’est pas ces quelques changements qui feront de votre article un « nouvel article ». Est-ce par manque de temps ou par manque de créativité que les gens ne font pas l’effort d’offrir de nouveaux contenus ?

4. Ignorer son propre site

Parfois, on prend énormément de temps à publier un article de qualité sur un site internet externe dans le but d’avoir un lien vers son propre site. Cependant, il est plus intéressant de créer du contenu pertinent pour son propre site internet car cela permettra parfois de gagner plusieurs liens organiques et naturels à la place d’un seul.

5. Être obsédé par les ancres

C’est certainement moins visible depuis que la mise à jour de Penguin a été effectuée mais c’est quand même parfois surprenant de voir que certains sites internet ont un pourcentage de backlinks avec une ancre à mot clé supérieur au nom de l’entreprise. Voulez-vous qu’on connaisse votre entreprise par un mot clé ou par son véritable nom ?

Evidemment, il est toujours important d’ancrer ses liens car on a besoin de ce lien avec ce mot clé mais il faut bien moins de liens à correspondance exacte qu’il y a deux ans.

6. Arrêter le guest-blogging

Attendez avant de me lyncher et de me dire que le guest-blogging est nécessaire. Quand je dis qu’il faut arrêter le guest-blogging, cela veut dire qu’il faut arrêter de le faire si on ne connait pas son sujet à 100%. Ces rédacteurs qui publient 10 articles par jour sont-ils réellement pertinents ?

Le guest-blogging peut très bien marcher à condition que l’article soit bien réalisé et qu’il apporte une réelle plus-value.

7. Publier un communiqué de presse sans plus-value

Il ne faut publier un communiqué de presse que lorsque vous apportez une information réellement digne d’intérêt. Un exemple : le lancement d’un nouveau produit. Dans le cas contraire, il vaut mieux s’abstenir.

8. Est-ce que vous pensez que cela peut marcher ?

Si vous avez d’autres conseils à donner pour un référencement plus naturel et plus performant, n’hésitez pas à nous le faire savoir dans les commentaires ci-dessous !

Dans une nouvelle vidéo publiée hier sur Youtube, Matt Cutts tente d’expliquer trois thèmes parmi les idées fausses provenant de l’industrie du SEO. En 5 minutes, le chef de l’équipe anti-spam de Google explique :

Dans une nouvelle vidéo publiée hier sur Youtube, Matt Cutts tente d’expliquer trois thèmes parmi les idées fausses provenant de l’industrie du SEO. En 5 minutes, le chef de l’équipe anti-spam de Google explique :

- Que les référenceurs confondent souvent les mises à jour des algorithmes avec le rafraîchissement de données;

- Que les algorithmes Panda et Penguin n’ont pas vocation de faire rentrer plus d’argent dans les caisses de Google;

- Et enfin que les référenceurs se centrent trop sur la stratégie de linkbuilding et sur les moteurs de recherche.

Algorithmes et mises à jour :

La principale différence entre une mise à jour de l’algorithme et un rafraîchissement des données de celui-ci consiste dans le fait que lorsque Google effectue une mise à jour, cela influence la manière dont les résultats sont classés, filtrés et indexés. A l’inverse, le rafraîchissement des données met simplement les données à jour.

Matt Cutts nous offre un exemple : Penguin 2 et 3 étaient des rafraîchissements de données tandis que Penguin 4 (ou Penguin 2.0) était une mise à jour.

Les gains de Google via Panda et Penguin :

Beaucoup de personnes pensent que Panda et Penguin n’existent que pour augmenter les revenus de Google. Cependant, Matt Cutts tient à clarifier cela en précisant que les algorithmes et les résultats de recherche organique sont séparés au niveau des revenus. Au contraire, Matt Cutts explique que Panda peut avoir des conséquences négatives sur les bénéfices de Google car son objectif est de faire disparaître les contenus de faibles qualité. Or ces sites sont principalement monétisés par les revenus AdSense.

Les référenceurs se concentrent trop sur le link-building

Ce n’est pas la première fois que Matt Cutts utilise ce genre de discours : les référenceurs se concentrent trop sur le link-building et sur le moteur de recherche au lieu de travailler pour l’utilisateur. Pour lui, les grands sites se basent avant tout sur l’expérience de l’utilisateur car plus ce dernier est content, plus il le recommandera à d’autres utilisateurs.

Voici la vidéo complète de Matt Cutts : « What are some misconceptions in the SEO industry ? »

Merci à Abondance et à Searchengineland

Matt Cutts a publié une nouvelle vidéo hier après-midi. Dans cette dernière, le chef de la recherche anti-spam de Google répond à certaines questions que se posent webmasters et référenceurs quant à l’avenir du référencement. Plus précisément, la question à laquelle Matt Cutts a répondu était:

Matt Cutts a publié une nouvelle vidéo hier après-midi. Dans cette dernière, le chef de la recherche anti-spam de Google répond à certaines questions que se posent webmasters et référenceurs quant à l’avenir du référencement. Plus précisément, la question à laquelle Matt Cutts a répondu était:

« What should we expect in the next few months in terms of SEO for Google? »

Dans cette vidéo un peu plus longue qu’à l’accoutumée (7 min 24 avec un t-shirt noir rappelant le logo de Firefox), Matt Cutts dresse 10 points qu’il résume à la fin de la vidéo. 10 points qui devraient permettre d’augmenter les résultats de recherche sur Google en récompensant les bons sites et en pénalisant les mauvais (spammeurs, black hat, etc.). Pour rappel, nous vous indiquions hier que ce même Matt Cutts annonçait une nouvelle version de Penguin pour les prochaines semaines (« Penguin 2.0 sortira dans quelques semaines« , qui est d’ailleurs le premier point énoncé par Matt Cutts).

- La prochaine mise à jour de Penguin va aller plus loin et va avoir plus d’impact que les précédentes.

- Le publireportage risque d’être plus sévèrement combattu par l’équipe anti-spam de Google car ils gonflent artificiellement les profils.

- Les requêtes spam : Google va également se pencher de manière plus radicale sur certaines requêtes dites « spammy », c’est-à-dire des requêtes à tendance pornographiques par exemple.

- Google veut aller plus loin (« upstream ») pour dissuader les spammeurs et pour diminuer la valeur des liens qu’ils acquièrent.

- Une analyse des liens plus sophistiquée : Google est actuellement en train de mettre au point des logiciels beaucoup plus sophistiqués pour analyser les liens.

- Continuer à améliorer la prévention pour les sites piratés : ces derniers temps, Google a beaucoup travaillé pour prévenir les internautes qu’un site pouvait potentiellement avoir été piraté. L’équipe anti-spam de Matt Cutts veut continuer dans cette optique et les enlever des résultats de recherche.

- Booster l’autorité : Google veut donner plus d’autorité aux sites qui sont des références dans leur industrie, dans leur communauté. Cela devrait permettre à ces sites dits « d’autorité » de gagner des places dans le classement des résultats de recherche.

- Adoucissement de Panda : d’après Google, certains sites touchés par Panda sont des cas « limites ». Du coup, Matt Cutts cherche un moyen d’adoucir l’impact de Panda sur certains sites en analysant d’autres qualités afin que ces sites ne soient pas touchés par Panda.

- Les regroupement des URL d’un même nom de domaine dans la première page de résultats : le nombre de noms de domaine identiques figurant sur la première page de résultats devrait être réduit afin de rendre cette page de résultats plus diversifiée. Par contre, une fois sur la deuxième page de résultat, des noms de domaine identiques pourront plus facilement se retrouver.

- Améliorer la communication avec les webmasters : Matt Cutts veut offrir des informations plus détaillées aux webmasters dans le Google Webmaster Tools.

Voici la vidéo complète dans laquelle Matt Cutts énumère ces différents points dans le but d’empêcher le black hat de truster les premières places du résultat de la recherche.

Source : Searchengineland.com

Il y a encore quelques années, les stratégies de référencement utilisées par certaines agences étaient simples car elles consistaient à générer des milliers de liens (spams), à proposer quelques mots clés sur certains sites et à débourser un peu d’argent pour que le mot clé désiré se situe en bonne position « en fin de journée ».

Retour sur l’héritage du spam

Cependant, aujourd’hui, beaucoup de référenceurs ont travaillé afin de faire évoluer leurs pratiques mais il reste encore un certain héritage du spam qu’il faut essayer de nettoyer.

Depuis le début des pratiques en référencement, le spam a été présent. En effet, il y a toujours eu des professionnels qui ont fait du « keywordstuffing », qui ont proposé des commentaires spams sur des blogs, qui ont créés des textes générés par des robots ou qui ont acheté des liens. D’ailleurs, certains référenceurs peu scrupuleux utilisent encore et toujours (malheureusement) ce genre de pratiques, aussi risquées soient-elles.

Cependant, à l’époque, ces techniques étaient efficaces et c’est pour cette raison que certains spécialistes s’y sont engouffrés. Malheureusement, ces techniques ont engendré du spam et ces spécialistes n’en connaissaient pas encore les conséquences.

Google s’est défendu

Avec le recul, on se rend compte que ces pratiques n’étaient pas bonnes. Aujourd’hui, tout référenceur doit avoir compris qu’un bon lien est un lien naturel, pertinent et utile. En d’autres mots, le lien doit améliorer le site internet, ne pas seulement servir les moteurs de recherche, ne pas faire partie d’une série d’ancres sur-optimisées sur des blogs non-pertinents et, enfin, être construit à destination des internautes.

Avec le recul, on se rend compte que ces pratiques n’étaient pas bonnes. Aujourd’hui, tout référenceur doit avoir compris qu’un bon lien est un lien naturel, pertinent et utile. En d’autres mots, le lien doit améliorer le site internet, ne pas seulement servir les moteurs de recherche, ne pas faire partie d’une série d’ancres sur-optimisées sur des blogs non-pertinents et, enfin, être construit à destination des internautes.

C’est pour éviter ces pratiques néfastes pour l’expérience de l’utilisateur que Google a d’abord lancé la mise à jour Panda afin de toucher les sites proposant des contenus dupliqués ou à peine changés. Puis il a mis sur pied le filtre Penguin afin de lutter contre le spam et les abus d’ancres identiques dans les articles.

C’est à ce moment-là que les experts du référencement qui pratiquaient le spam ont commencé à penser différemment.

L’évolution du référencement

Après Google Panda et Penguin, les sites qui avaient acheté des liens en masse ont perdu énormément de places dans les résultats de recherche. Du coup, il a fallu revoir les règles du jeu.

Aujourd’hui, si l’on veut offrir un référencement efficace à nos clients, il n’est plus question de mettre en place de telles pratiques et d’offrir au site internet des liens par milliers tous les mois. Dorénavant, les liens doivent être créés par des humains, pour des humains et les sites ne doivent plus disposer de milliers de liens par mois mais seulement d’une dizaine de liens efficaces.

Pour offrir un référencement de qualité à l’heure actuelle, il est nécessaire de :

- Créer des liens pertinents sur les sites qui sont modérés et lus par des humains;

- Examiner chaque site sur lequel nous travaillons et toujours fournir du contenu utile au site;

- Eviter de se tourner vers la solution de facilité, c’est-à-dire de payer pour des outils qui créeront des milliers de liens (mais qui seront discrédités par Google);

- Se concentrer sur des liens durables. Ce ne sont pas les plus faciles à mettre en place mais l’effort en vaut la peine car ils ne seront jamais discrédités. Il vaut mieux prendre un peu plus de temps pour mettre un bon lien en place que de devoir revoir toute sa stratégie de référencement;

- Privilégier la qualité plutôt que la quantité. Dix liens solides et pertinents tous les mois sont préférables à mille liens douteux.

En conclusion

Bien que courte, l’histoire du référencement a déjà eu le temps de laisser quelques traces d’ombres derrière elle et le spam en fait partie. Beaucoup de clients ont eu de mauvais échos suite à ces pratiques douteuses utilisées dans le passé par certaines agences. Dorénavant, pour se construire un nouvel héritage, il est important de privilégier les techniques de référencement pertinentes et transparentes. Entre autres choses, les liens doivent aujourd’hui être éthiques, durables et efficaces. Même si certains continuent à proposer des liens spams, il faut espérer que le monde du référencement se tourne définitivement vers le « white hat ».

Source : Searchenginewatch

Pour beaucoup de référenceurs et de webmasters, la 25e mise à jour de Google Panda a eu lieu le vendredi 15 mars, conformément à ce que Matt Cutts avait annoncé (« Matt Cutts annonce des mises à jour Panda et Penguin »). Il s’agirait cependant de la dernière fois que la date d’une mise à jour visant à pénaliser les sites de mauvaise qualité est dévoilée.

En effet, d’après le site toujours très bien informé Searchenginland.com, Google n’a pas confirmé ni infirmé la rumeur et il est probable que le géant du moteur de recherche ne le fasse plus à l’avenir car dorénavant les mises à jour de Panda devraient s’étaler sur plusieurs jours. Voici donc les déclarations d’un porte-parole de Google :

« I don’t expect us to tweet about or confirm current or future Panda updates because they’ll incorporated into our indexing process and thus be more gradual »

Avez-vous remarqué des pertes de trafic ce weekend sur votre site internet ? Pensez-vous qu’il a été touché par Panda ? Si oui, n’hésitez pas à nous contacter, nous analyserons la visibilité de votre site avec vous et nous vous aiderons à récupérer votre visibilité !

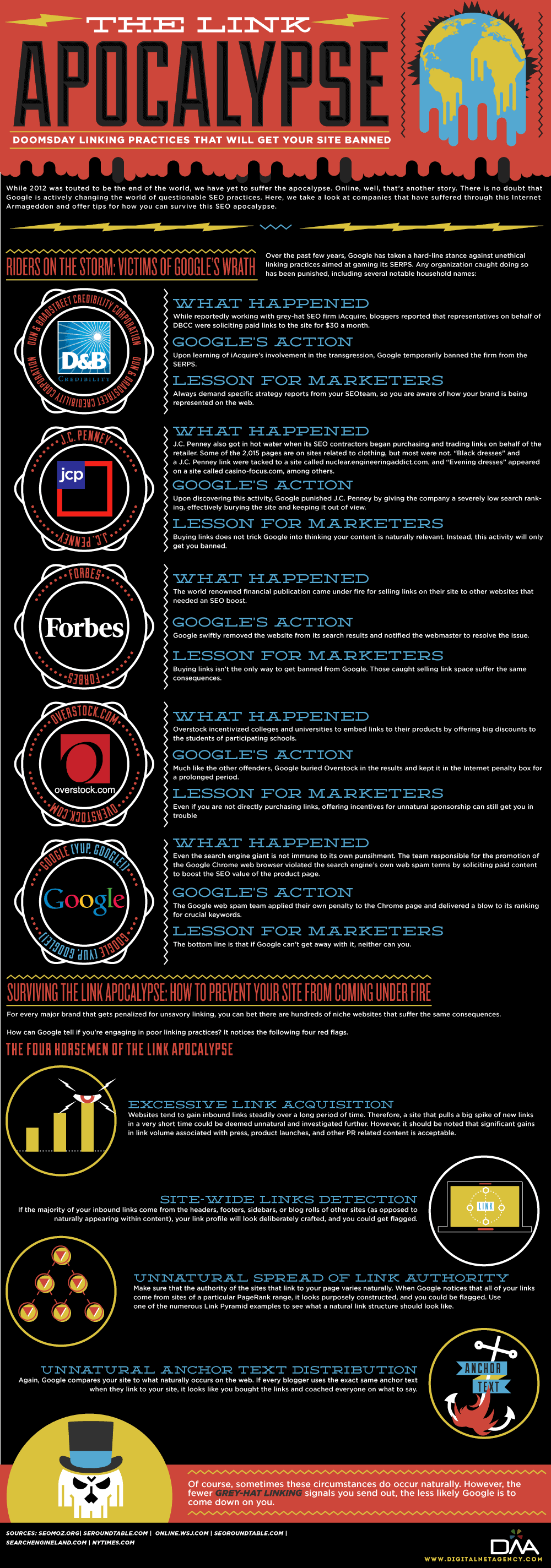

Depuis quelques années, Google met à jour des algorithmes qui peuvent faire mal à un site internet et à son référencement. Avoir un bon link building est important lorsque l’on veut gagner en visibilité. Mais attention à ne pas commettre d’erreurs pour ne pas connaitre les foudres de Penguin ou de Panda.

Pour éviter que votre site ne perde complètement sa visibilité et pour vous empêcher d’aller trop loin dans le link building, les gens de Digitalnetagency ont créé une infographie (« The Link Apocalypse ») reprenant les erreurs récentes qui ont été faites par quelques entreprises (dont Google himself !).

Voici donc les quelques erreurs à ne pas reproduire :

Via Searchengineland