Entre la confiance toujours plus large accordée par Google en l’intelligence artificielle et la très attendue mise à jour de Google Penguin (pour ne citer que ça), le monde du référencement fut, en 2016, soumis à de profonds chamboulements. L’année 2017 à peine débutée, distinguons d’ores et déjà 8 tendances susceptibles de faire parler d’elles dans les mois à venir.

Du changement du côté des SERP

Google s’est l’année dernière essayé à quelques tests concernant l’apparence des SERP. L’une de ces modifications portait par exemple sur la longueur des balises Title. Il ne fait nul doute que le géant des moteurs de recherche continue à l’avenir ce type d’expérimentation en vue d’attirer l’œil des internautes tout en favorisant les sites portant attention à ces multiples détails.

Une plus grande importance donnée à l’expérience utilisateur

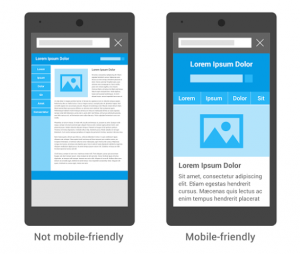

Les internautes deviennent de plus en plus exigeants quant à la facilité de navigation d’un site web, davantage encore depuis mobile. L’expérience utilisateur devrait donc à l’avenir prendre plus de place dans les stratégies SEO. Plus un internaute se sent bien sur un site internet plus il y passe de temps et plus il y passe de temps mieux c’est pour le SEO. Les référenceurs ont dont tout à y gagner. Si l’optimisation d’un site est importante, rappelons qu’il ne faut jamais en oublier cette fameuse expérience utilisateur…

Autres changements à venir

Outre ces deux tendances, il y a fort à parier que la recherche vocale, l’intelligence artificielle ou encore les contenus de qualité soient amenés à prendre davantage de place dans les mois, voire les années à venir. L’essentiel? Se tenir prêt à affronter tous ces changements afin d’en tirer parti! Il y a donc encore beaucoup de boulot à réaliser… 😉

Découvrez ces autres tendances au travers de l’infographie ci-dessous.

Vous souhaitez de l’aide en vue d’atteindre les objectifs que vous vous êtes fixés? Référenceur peut vous aider: n’hésitez pas à nous contacter.

Sources: Digital Marleting

Traduction libre d’un article de Matt Secrist publié sur SearchEngineJournal.

Le référencement naturel (SEO) et la rédaction de contenu (copywriting) sont deux domaines qui peuvent sembler éloignés l’un de l’autre mais qui, en réalité, sont plus proches qu’on ne le pense car, en les réunissant, c’est le content marketing qui a vu le jour.

Le référencement naturel (SEO) et la rédaction de contenu (copywriting) sont deux domaines qui peuvent sembler éloignés l’un de l’autre mais qui, en réalité, sont plus proches qu’on ne le pense car, en les réunissant, c’est le content marketing qui a vu le jour.

Concrètement, le SEO cherche à plaire aux moteurs de recherche alors que la rédaction de contenu vise plutôt à offrir aux internautes des informations concrètes, complètes et précises.

Il y a une époque où la rédaction de contenu et le SEO étaient véritablement en compétition mais, depuis quelques années, ce rapport de force a évolué, notamment grâce aux améliorations apportées par Google.

SEO et rédaction de contenu

Le référencement naturel consiste à améliorer le contenu du site internet et de manipuler certains éléments en vue d’attirer les robots des moteurs de recherche et de surclasser les concurrents. La rédaction de contenu, elle, consiste à créer du contenu qui provoque des émotions chez le lecteur et qui le pousse à passer à l’action, c’est-à-dire à acheter un produit, à demander des informations complémentaires, à s’inscrire à une liste d’email, à cliquer sur un lien, etc.

Pour que le mélange entre SEO et copywriting soit efficace, il est important de les équilibrer et de créer une certaine harmonie entre eux. Voici 10 conseils qui devraient vous permettre d’y arriver:

1. Choisir le bon titre

En général, on désigne le titre comme l’élément le plus important de la rédaction et il est essentiel de prendre deux choses en considération quand on travaille le titre de son texte:

- Attirer l’attention du lecteur: Est-ce que le titre est directement saisissable par le lecteur ? Est-ce que si vous étiez à la place du lecteur, vous auriez envie de cliquer ?

- Les mots clés: Est-ce que votre titre est optimisé pour le référencement ? Pas si vous n’y incluez pas au moins un mot clé (mais attention à ce que l’insertion de mots clés ne se fasse au détriment de l’attrait du lecteur !)

Combiner un titre et un sous-titre peut s’avérer également très utile car cela donne en même temps des informations aux lecteurs ET aux moteurs de recherche.

Envie d’en savoir plus sur la création des titres ? Découvrez 102 formules qui fonctionnent ici !

2. Donner de l’importance au message

Avant d’écrire quoi que ce soit, il est nécessaire de connaitre votre audience afin de savoir ce qui l’intéressera. Parfois, il sera intéressant d’écrire des articles provenant de sujets relevés dans les commentaires reçus sur d’autres publications.

Avant d’écrire quoi que ce soit, il est nécessaire de connaitre votre audience afin de savoir ce qui l’intéressera. Parfois, il sera intéressant d’écrire des articles provenant de sujets relevés dans les commentaires reçus sur d’autres publications.

En ce qui concerne le contenu du message, on vous conseille d’éviter de parler uniquement de vous et de faire sans arrêt la promotion de vos produits. Plutôt que cela, racontez plutôt des histoires intéressantes, offrez des conseils pertinents et résolvez des problèmes.

3. Améliorer le design pour augmenter les lectures

Le design, la mise en forme et la mise en page d’un article déterminent de plus en plus la lecture (ou non) de l’internaute. Si le contenu forme un bloc peu aéré et peu structuré, il y a beaucoup de chances que l’internaute passe son tour. Par contre, pour attirer le lecteur, on peut:

- Proposer des espaces vides pour laisser respirer l’internaute

- Offrir des paragraphes courts

- Utiliser des listes

- Segmenter le texte avec des intertitres

Notez aussi qu’il ne faut pas spécialement rendre tout le contenu court mais bien chaque élément séparément.

4. Utiliser des mots clés

Si l’utilisation des mots clés a certainement perdu un peu de son importance ces dernières années (notamment parce que les internautes recherchent de plus en plus d’expressions qui n’ont jamais été recherchées – voir notre récente infographie sur le sujet pour en découvrir davantage), les mots clés figurent toujours parmi les facteurs de ranking de Google et doivent donc toujours être pris en compte (de même que leurs synonymes).

Si vous vous efforcez d’écrire quelque chose d’utile et de pertinent, les mots clés s’intégreront naturellement dans votre article et ils permettront de travailler la longue traîne de votre site web.

5. Les liens

Au cours des dernières années, de nombreux webmasters ont usé et abusé de liens dans le but de manipuler les moteurs de recherche. Conséquence: Google a durcit ses règles en lançant (notamment) Google Penguin, un filtre qui vise à pénaliser les sites qui faisaient et recevaient des liens à tort et à travers.

Pour utiliser les liens proprement, voici ce qu’il convient de faire:

- Faire des liens externes vers de sites d’autorité qui offrent des informations complémentaires à vos lecteurs

- Faire des liens internes (au sein de votre site internet) afin de permettre aux internautes d’en découvrir davantage sur votre univers, vos prestations, etc.

6. Des images pour un visuel plus agréable

En général, on considère que les internautes réagissent mieux aux images qu’aux mots. C’est pour cette raison qu’il est indispensable d’insérer des images pertinentes et attrayantes au sein de votre contenu.

Outre son côté esthétique, l’ajout d’images offrira un atout supplémentaire pour le référencement naturel (si les images sont bien optimisées: balises <alt>, taille, nom du fichier, etc.)

7. Les appels à l’action (Call To Action)

Evidemment, si vous prenez le temps d’écrire des contenus intéressants, pertinents et suffisamment longs, c’est avant tout parce que vous souhaitez retirer quelque chose des internautes, par exemple:

- Offrir votre aide

- Résoudre un problème

- Économiser de l’argent

- Bénéficier d’une offre gratuite

- Etc.

8. Une Meta Description qui tue !

Si vous avez pris le temps d’écrire un texte qualitatif provenant de votre domaine d’activité, vous ne pouvez pas passer à côté de la rédaction de la balise Meta Description. Cette balise doit contenir le résumé de votre article tout en étant attrayante pour le lecteur car, dans de nombreux cas, c’est elle qui sera affichée sous le titre de votre article dans les résultats de recherche de Google.

Pour le référencement, cette balise de 150 à 160 caractères doit comprendre les mots clés essentiels de votre article sans paraître artificielle…

Dans l’exemple ci-dessus, la balise Meta Description est la suivante: « Quelles sont les tailles idéales à utiliser… sur Facebook »

9. Une balise Title qui incite les lecteurs

Encore davantage que la balise Meta Description, la balise Title est cruciale pour le référencement naturel car elle permet de se positionner au mieux dans les résultats naturels de Google.

Il faut savoir que les balises Title sont courtes (pas plus de 50 à 60 caractères). Elle doit donc être concise et précise tout en incitant les lecteurs à cliquer dessus car c’est la première chose qu’ils verront dans les résultats de recherche.

Dans l’exemple ci-dessus, la balise Title est la suivante: « Le guide 2015 des tailles des images sur les réseaux sociaux »

10. Partager le contenu sur les réseaux sociaux

Le but de Google consiste à mettre en évidence ce que les internautes apprécient et ce qu’ils trouvent pertinent, populaire et important. Quel meilleur moyen pour cela que de suivre ce qui est partagé massivement sur les réseaux sociaux ?

Le but de Google consiste à mettre en évidence ce que les internautes apprécient et ce qu’ils trouvent pertinent, populaire et important. Quel meilleur moyen pour cela que de suivre ce qui est partagé massivement sur les réseaux sociaux ?

On ne dit pas ici que c’est parce qu’un article est très partagé qu’il se retrouvera au top sur le moteur de recherche mais il s’agit d’un élément qui pourra attirer l’attention de Google !

Pour améliorer les partages et faciliter la vie des internautes, n’hésitez pas à ajouter des boutons de partage sur vos pages et vos articles, suivez les partages et n’hésitez pas à participer aux discussions…

Conclusion

En suivant ces différents conseils, vous devriez être prêt à écrire du contenu pertinent à la fois pour les internautes et pour les moteurs de recherche.

Vous souhaitez de l’aide pour améliorer le référencement naturel de votre site internet ? N’hésitez pas à contacter notre agence de référencement ! 😉

Quelles sont les bases d’un bon référencement en 2015 ? Quels sont les éléments qui pourraient affaiblir votre site internet ? Quelles sont les bonnes pratiques à mettre en oeuvre ? Pour le savoir, découvrez cette infographie réalisée par StudentExperts.com

Au fur et à mesure que les années passent, les stratégies à mettre en oeuvre pour un bon référencement de son site internet évoluent. Après Google Panda, Google Penguin et Google Hummingbird, le moteur de recherche a dernièrement lancé deux nouveaux éléments dans son algorithme afin de le rendre plus puissant et plus précis: Google Pigeon et Google Mobile-Friendly.

En 2015, il faut donc s’assurer que son site est compatible pour les appareils mobiles, qu’il est suffisamment rapide pour charger rapidement et offrir une bonne expérience aux internautes, qu’il n’enfreint pas les consignes de Google, qu’il utilise des mots clés de façon naturelle ou encore qu’il détienne une forte présence sur les réseaux sociaux.

Pour en apprendre davantage sur ces différentes thématiques mais aussi pour découvrir pourquoi il est important de référencer son site internet sur Google, n’hésitez pas à découvrir l’infographie relayée ci-dessous.

Pour davantage d’informations sur nos stratégies en référencement naturel, n’hésitez pas à nous contacter ! 😉

Alors que nous arrivons à la fin du mois de juillet, il nous semble intéressant d’établir un petit récapitulatif des évolutions qui ont émaillé le domaine du référencement naturel (SEO) au cours des sept premiers mois de l’année 2015. Entre l’annonce de l’algorithme mobile-friendly de Google, les nouveautés du Knowledge Graph ou encore les mises à jour du moteur de recherche, le petit monde du SEO a, comme à son habitude, évolué pas à pas.

Google lance son algorithme mobile-friendly

Nous l’avions prédit dès le mois de janvier à cause des nombreuses évolutions de Google concernant les recherches mobiles (notamment l’apparition du sigle mobile-friendly) et suite aux avertissements de Google aux webmasters dont les sites n’étaient pas optimisés pour les appareils mobile mais ce n’est finalement qu’à la fin du mois de février que le moteur de recherche a annoncé le lancement de son nouvel algorithme, prévoyant sa sortie pour le 21 avril 2015.

Nous l’avions prédit dès le mois de janvier à cause des nombreuses évolutions de Google concernant les recherches mobiles (notamment l’apparition du sigle mobile-friendly) et suite aux avertissements de Google aux webmasters dont les sites n’étaient pas optimisés pour les appareils mobile mais ce n’est finalement qu’à la fin du mois de février que le moteur de recherche a annoncé le lancement de son nouvel algorithme, prévoyant sa sortie pour le 21 avril 2015.

Pour beaucoup de spécialistes en référencement naturel, l’algorithme mobile-friendly de Google a accouché d’une petite souris alors que beaucoup s’attendaient à des changements importants au sein des résultats de recherche mobile (Google avait notamment indiqué que cet algorithme aurait davantage d’impact que Google Panda ou Google Penguin).

On peut toutefois espérer que la mise à jour de cet algorithme a eu pour conséquence de pousser de nombreuses entreprises à proposer un site mobile-friendly aux internautes, avec pour effet une amélioration de l’expérience de ces derniers. Google a notamment annoncé une hausse du nombre de sites mobile-friendly de près de 5% entre février et avril 2015.

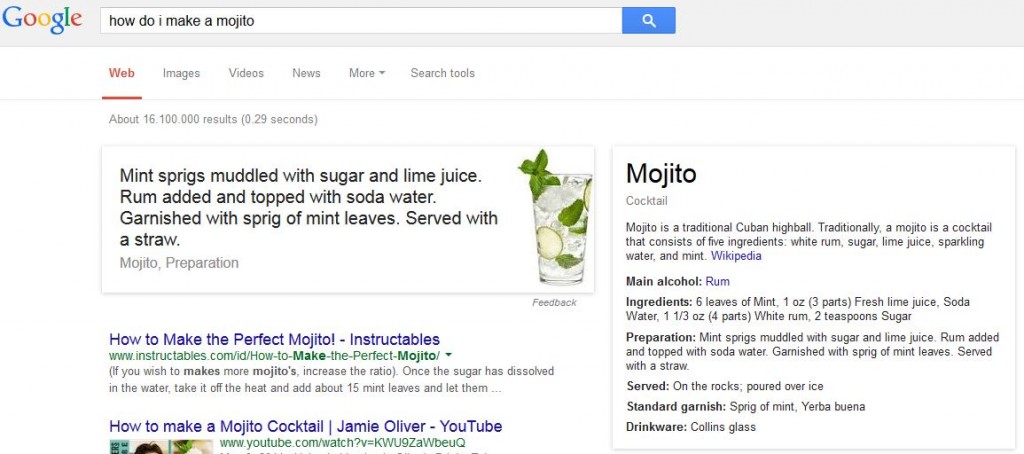

Le Knowledge Graph s’affine de plus en plus

Lancé aux Etats-Unis en 2012, le Knowledge Graph (ou graphe de connaissance) de Google n’a cessé d’évoluer depuis lors. Son but premier consiste à favoriser l’expérience des internautes en leur permettant d’obtenir directement des réponses à leurs questions.

Au départ, le Knowledge Graph permettait d’obtenir des informations sur des personnalités ou des lieux culturels (par exemple) puis, petit à petit, il s’est amélioré pour permettre d’expliquer comment faire des cocktails, réserver un hôtel lors de la recherche d’une ville, découvrir du contenu médical, connaitre la taille de certaines personnalités ou de bâtiments, les horaires de films au cinéma ou encore des informations particulières concernant des romans.

Les mises à jour de Google en 2015

Comme à son habitude, Google n’a pas été très prolixe à propos d’éventuelles mises à jour de son algorithme au cours de cette première moitié d’année. On retiendra donc:

- Qu’il semblerait que Google ait modifié son algorithme visant à combattre les pages satellites entre mars et mai 2015

- Que le moteur de recherche a indiqué que Google que Google Penguin ne serait pas mis à jour prochainement

- Qu’une mise à jour « Google Quality » a été lancée au début du mois de mai 2015

- Qu’une mise à jour de Google Panda (Google Panda 4.2) est en cours depuis le 18 juillet 2015 et qu’elle pourrait durer plusieurs mois

- Que les résultats locaux de Google ont été mis à jour à l’international au début du mois de juin 2015

Evidemment, d’autres mises à jour plus confidentielles ont également vu le jour au cours de cette première moitié d’année mais elles n’ont pas été commentées par le moteur de recherche.

Les autres informations à retenir

Parmi les autres informations qui ont animé les débats au cours de cette première moitié d’année et qui méritent de se retrouver dans ce récapitulatif, on notera le fait que Google cherche actuellement à lancer un bouton « Buy » au sein de ses résultats de recherche. Celui-ci semble avoir été déployé aux Etats-Unis et a pour objectif de concurrencer Amazon et de pousser les internautes à rester plus longtemps sur le moteur de recherche.

Plus d’informations sur le sujet dans cet article: Google va intégrer un bouton « Buy » dans ses pages de résultats

Une autre information à retenir réside dans le fait que Twitter insère à nouveau ses tweets dans le moteur de recherche de Google (comme cela avait déjà été le cas entre 2009 et 2011).

Enfin, on épinglera cette nouvelle fonctionnalité offerte par Google: la Location Aware Search qui permet de demander des informations sur un lieu précis sans devoir le nommer mais en se trouvant simplement à proximité du lieu.

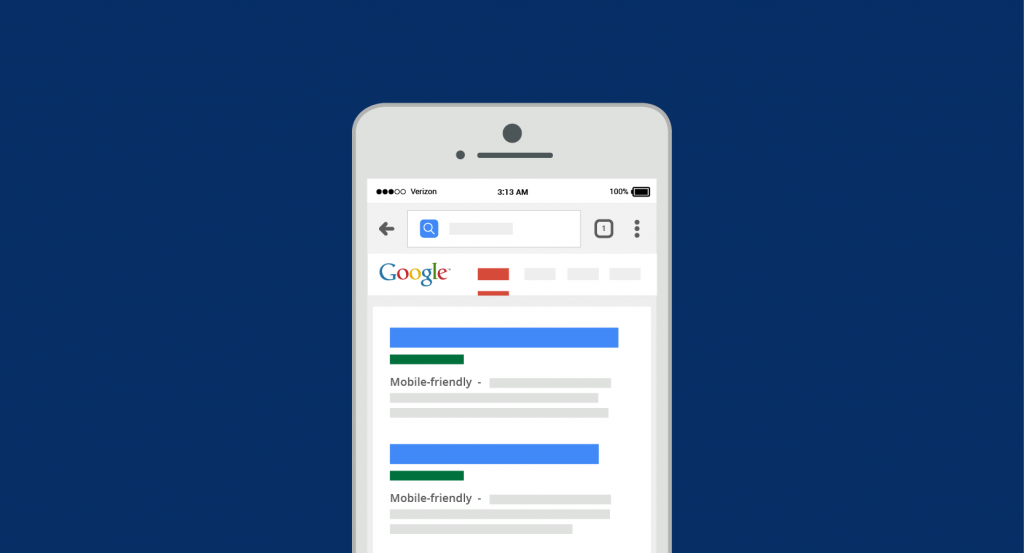

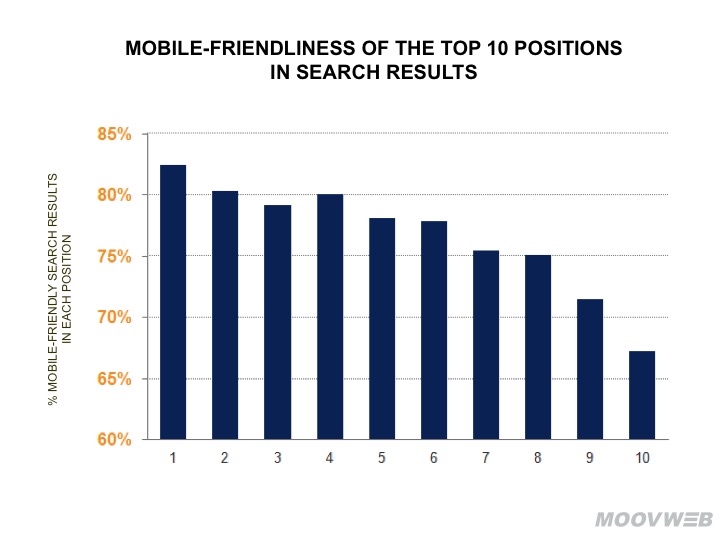

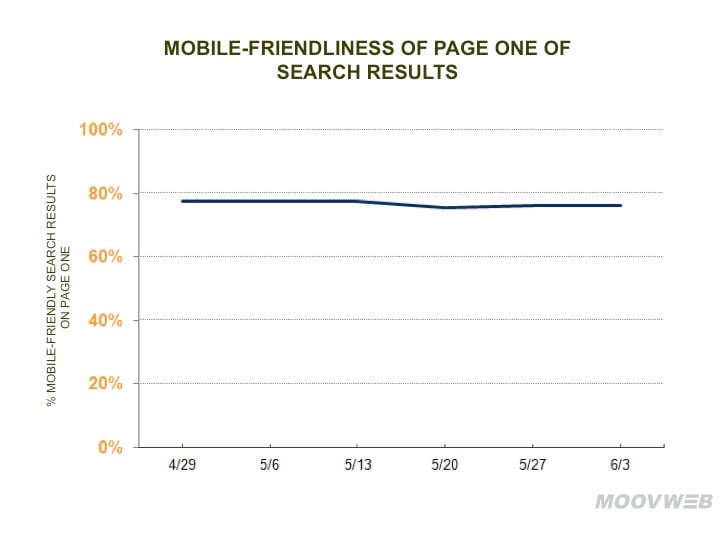

Une récente étude réalisée par Moovweb indique que les sites mobile-friendly dominent les premières positions des résultats de recherche de Google. D’après les résultats récoltés, un site mobile-friendly arrive en première position des SERP dans 83% des situations. Mais est-ce que l’algorithme mobile-friendly y est pour quelque chose ?

A la fin du mois d’avril, Google a lancé un nouvel algorithme qui était censé révolutionner les résultats de recherche mobile. Cet algorithme mobile-friendly n’a pas eu l’effet escompté aux yeux de nombreux webmasters qui s’attendaient à voir des changements importants dans les SERP de Google puisque le moteur de recherche avait annoncé que cette modification de l’algorithme mobile aurait un impact plus important que Google Panda ou Google Penguin par exemple.

A la fin du mois d’avril, Google a lancé un nouvel algorithme qui était censé révolutionner les résultats de recherche mobile. Cet algorithme mobile-friendly n’a pas eu l’effet escompté aux yeux de nombreux webmasters qui s’attendaient à voir des changements importants dans les SERP de Google puisque le moteur de recherche avait annoncé que cette modification de l’algorithme mobile aurait un impact plus important que Google Panda ou Google Penguin par exemple.

Plusieurs semaines après le déploiement de l’algorithme mobile-friendly (qui a été surnommé « Mobilegeddon » dans le monde du SEO), Moovweb a réalisé une étude ayant pour ambition d’analyser la façon dont les sites mobile-friendly se positionnent dans les résultats de recherche mobile de Google depuis lors.

La méthodologie de l’étude

Pour réaliser cette étude, Moovweb a sélectionné 1.000 mots clés provenant de secteurs aussi divers et variés que la vente au détail, les soins de santé, les transports, le voyage, l’éducation ou encore l’assurance. Les URL apparaissant dans les 10 premiers résultats de ces mots clés ont été analysé depuis la fin avril jusqu’au début du mois de juin afin de découvrir s’il s’agissait de sites web mobile-friendly ou non.

Moovweb a également analysé le pourcentage de sites internet qui disposaient du label mobile-friendly dans les SERP.

Les résultats de l’étude

Moovweb a partagé les résultats de cette étude sur son blog ce mercredi et on y découvre que le pourcentage de résultats mobile-friendly en première position des mots clés choisis se situait en moyenne à 83%. Sans surprise, plus on descendait dans les positions des SERP, plus le pourcentage de sites mobile-friendly diminuait également. Ainsi, le cinquième résultat de recherche avait en moyenne 5% de résultat mobile-friendly en moins que la première position.

Voici le graphique qui reprend ces résultats:

Si on décide de prendre les 10ères positions de Google comme un ensemble, on remarque que le pourcentage moyen de résultats mobile-friendly se situe à 77% et que cette moyenne est restée stable tout au long de l’étude (qui a tout de même duré environ 6 semaines).

Conclusion

Google avait annoncé le lancement de sa mise à jour mobile-friendly en affirmant que celle-ci aurait un impact sans précédent mais les changements n’ont pas été très nombreux. La preuve: la communauté spécialisée dans le référencement naturel sur Google n’a pas fait grand bruit de ce changement une fois qu’il a été déployé et on remarque aujourd’hui que, 2 mois plus tard, rien n’a réellement changé.

Google a cependant peut-être réussi son pari puisque de nombreux sites se sont certainement préparés à la mise à jour en devenant mobile-friendly avant le lancement officiel, ce qui a permis au moteur de recherche d’offrir naturellement des résultats plus pertinents aux internautes…

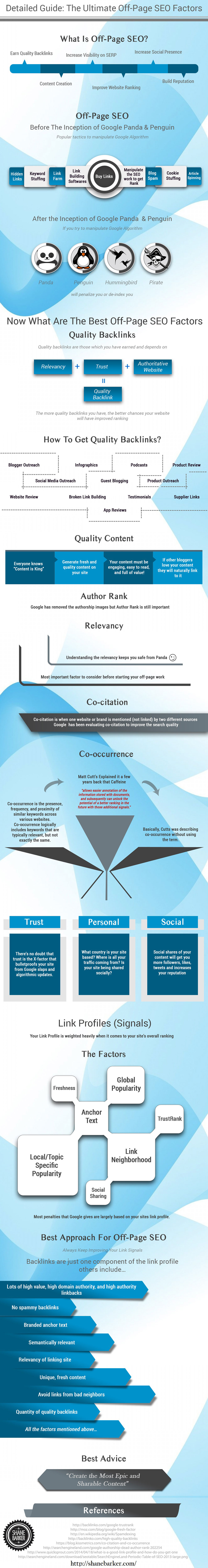

Le positionnement d’un site internet sur les moteurs de recherche dépend non seulement des facteurs On-Page (réglages des paramètres internes au site) mais aussi des facteurs Off-Page (link building, médias sociaux, etc.). Ces derniers ont pour objectif d’accroître le nombre de liens, de visites et de mentions sur les réseaux sociaux afin de gagner en visibilité. Voici une infographie qui reprend en détails les facteurs Off-Page d’un site web.

L’infographie que nous présentons ci-dessous a été réalisée par ShaneBarker et a pour ambition de démontrer l’importance des facteurs SEO Off-Page ainsi que leur évolution au fil du temps. En effet, ceux-ci ont pas mal évolué depuis les sorties de Google Panda, Google Penguin, Google Hummingbird ou encore Google Pirate. Finis les achats de liens massifs, les liens spammys, les liens cachés, le keywordstuffing ou encore les logiciels d’achat de liens. Depuis que Google a intégré ses filtres antispam, les stratégies ont évolué afin d’éviter de se faire pénaliser ou désindexer dans les résultats de recherche.

A l’heure actuelle, il est essentiel de trouver des backlinks de qualité pour permettre au site internet d’améliorer sa réputation et sa visibilité en ligne. Pour y arriver, on insistera avant tout sur la qualité du contenu, sa pertinence ainsi que sur le partage social.

Vous souhaitez découvrir plus d’informations sur le SEO Off-Page ? Découvrez cette infographie pertinente relayée ci-dessous ou contactez-nous pour de plus amples informations.

Il y a quelques mois, nous vous avions déjà proposé un récapitulatif de la première moitié de l’année au niveau du référencement (vous pouvez redécouvrir cet article ici). Mais depuis lors, de l’eau a encore coulé sous les ponts et le visage du SEO (Search Engine Optimization) a continué à changer. Nous reprendrons dans cet article les évolutions qui nous ont principalement marqué en 2014.

Google et le guest blogging

Le guest blogging est une pratique très répandue dans le domaine du référencement qui consiste à proposer des articles « invités » sur des blogs divers. Cependant, si cette stratégie peut s’avérer très bénéfique lorsqu’elle est réalisée intelligemment, elle peut également être pénalisante depuis cette année et l’annonce de Google de pénaliser le guest blogging.

Le guest blogging est une pratique très répandue dans le domaine du référencement qui consiste à proposer des articles « invités » sur des blogs divers. Cependant, si cette stratégie peut s’avérer très bénéfique lorsqu’elle est réalisée intelligemment, elle peut également être pénalisante depuis cette année et l’annonce de Google de pénaliser le guest blogging.

Matt Cutts avait déjà prévenu en 2013 qu’il fallait pratiquer le guest blogging avec modération et Google est ensuite passé à l’action en pénalisant des plateformes telles que MyBlogGuest.com ou PostJoint par exemple.

Si le guest blogging industrialisé est désormais pénalisé par Google, il semblerait que le fait de proposer des articles invités de qualité, intéressants et propres sur des blogs thématisés permette encore d’améliorer son référencement.

Pour avoir une idée de ce que Google considère comme guest blogging pénalisant, relisez cet article.

Google Penguin 3.0 déployé … sur le long terme

Certains attendaient son déploiement depuis plus d’un an afin de pouvoir sortir de la pénalité infligée par la précédente mise à jour (qui datait du mois d’octobre 2013). C’est finalement vers le 17 octobre que Google a annoncé le déploiement de Google Penguin 3.0. Un déploiement qui a énormément fait parler de lui puisque des mouvements dans le SERP ont été régulièrement décelés entre ce 17 octobre et le début du mois de décembre.

Certains attendaient son déploiement depuis plus d’un an afin de pouvoir sortir de la pénalité infligée par la précédente mise à jour (qui datait du mois d’octobre 2013). C’est finalement vers le 17 octobre que Google a annoncé le déploiement de Google Penguin 3.0. Un déploiement qui a énormément fait parler de lui puisque des mouvements dans le SERP ont été régulièrement décelés entre ce 17 octobre et le début du mois de décembre.

Finalement, le moteur de recherche a annoncé qu’il essayait vraiment de rendre permanentes les mises à jour de Google Penguin afin d’éviter des situations telles que celles vécues entre 2013 et 2014 par certains sites web.

On verra comment évolue cette mise à jour en 2015 mais il semblerait que Google veuille prendre une nouvelle direction pour Penguin après l’intégration de Google Panda dans son algorithme.

Au niveau des filtres du moteur de recherche, on épinglera également les sorties de :

2015 : une année mobile

Si nous nous permettons de parler de 2015 dans cette rétrospective SEO 2014, c’est essentiellement parce qu’au cours de cette fin d’année, Google a mis sur pied différentes évolutions ou tests afin d’améliorer l’expérience des internautes sur les appareils mobiles que sont les tablettes et les smartphones.

Si nous nous permettons de parler de 2015 dans cette rétrospective SEO 2014, c’est essentiellement parce qu’au cours de cette fin d’année, Google a mis sur pied différentes évolutions ou tests afin d’améliorer l’expérience des internautes sur les appareils mobiles que sont les tablettes et les smartphones.

Ainsi, si certaines études démontrent déjà que les recherches sur mobiles dépasseront celles sur PC au cours de l’année 2015, Google n’a pas attendu pour améliorer son interface mobile. C’est ainsi qu’on a pu apercevoir en cette fin d’année le sigle « mobile-friendly » qui permet à l’internaute de savoir si le site qu’on va visiter est compatible avec les appareils mobiles. Google a d’ailleurs prévu un outil de test qui permet à chacun de savoir si son site bénéficiera de cette mention.

Nous aurions également pu parler de la fin de l’authorship dans les SERP, de l’apparition du formulaire de demande de droit à l’oubli et de bien d’autres évolutions en référencement dans ce récapitulatif mais on pourrait alors y passer la nuit.

Pour ne rien manquer de l’actualité en référencement, sur les médias sociaux et dans les moteurs de recherche en 2015, n’hésitez pas à continuer à nous suivre régulièrement, à commenter les articles et à les partager sur les réseaux sociaux !

D’ici là, passez un excellent réveillon de nouvel An et rendez-vous l’année prochaine ! 😉

Tous les gens qui sont spécialisés dans le référencement depuis des années savent que le temps où l’obtention de centaines de liens en quelques heures pouvait améliorer le référencement d’un site est révolu (en tout cas, si on veut être référencé sur le long terme).

Depuis quelques années, il est effectivement nécessaire de prendre garde aux liens qu’on pose sur les différents sites internet. Cependant, de nombreux « spécialistes » n’arrivent pas à décrocher de leurs mauvaises habitudes et on voit encore régulièrement des offres proposant des « packs » en référencement avec des milliers de liens pour une somme dérisoire (prenez garde à de telles offres !).

A l’heure actuelle, plutôt que de soumettre son site internet sur des milliers de plateformes, il est préférable de choisir avec soin des plateformes pertinentes qui ne sentiront pas le spam à des kilomètres et qui pourront vous apporter de véritables visites de qualité.

Pour y arriver, il y a quelques mauvaises habitudes que certains spécialistes devront perdre. Nous en avons listé 4 en nous inspirant de cet article de Casie Gillete paru sur Search Engine Land.

1. Les soumissions dans les annuaires

Précisons-le de suite : tous les annuaires ne doivent pas être évités car certains sont bien tenus et proposent des sites internet dans des catégories bien spécifiques qui peuvent vous apporter du trafic.

Cependant, quand on dit qu’il faut éviter de soumettre son site internet dans les annuaires, cela veut dire que le temps où on plaçait des liens sur des centaines d’annuaires qui n’apportaient aucune plus-value est révolu. Aujourd’hui, il faut choisir ses annuaires de manière pertinente et établir une stratégie autour d’une série d’annuaires pour lesquels on peut avoir confiance.

Le type d’annuaire à éviter :

2. Les demandes de soumissions génériques par email

Tous ceux qui tiennent un blog à jour ont certainement déjà reçu des dizaines ou des centaines d’emails (en français ou en anglais) de la part de personnes qui vous proposent de publier un article sur votre blog.

Dans ce genre de situation, c’est votre jugement qui sera important. En effet, si vous vous rendez compte qu’il s’agit d’un email générique qui a été envoyé à des centaines de blogueurs, il vaut mieux ne pas y prêter attention. Par contre, si vous estimez que l’auteur de l’email peut apporter une plus-value à votre blog grâce à un article de qualité suivant votre ligne éditoriale, pourquoi ne pas l’accepter ?

Pour ceux qui envoient ce type d’email, il est également nécessaire de se poser les bonnes questions avant d’envoyer le message. Essayer ainsi de savoir de quoi parle le blog, qui est la personne qui le détient, quel genre d’article pourrait intéresser cette personne, etc.

Un exemple à éviter :

3. Poser uniquement des ancres ultra optimisées

De nouveau, dans un passé pas si lointain, il suffisait de quelques centaines de liens avec une ancre sur optimisée (c’est-à-dire un mot clé spécifique) pour que le site apparaisse subitement dans les meilleurs positions de Google sur ce mot clé.

Mais avec l’arrivée de Google Penguin, les choses ont changé et de nombreux sites se sont fait pénalisé par le filtre antispam du moteur de recherche. Devenu plus intelligent, le moteur de recherche parvient aujourd’hui à prendre en compte des synonymes, des mots clés relatifs ou encore des syntagmes complets. La diversité des ancres doit donc aujourd’hui être privilégiée.

Pour un référencement efficace et pour être certain de ne pas se faire pénalisé par les moteurs de recherche, il est primordial de mettre en place des stratégies axées sur l’expérience des internautes plutôt que sur les techniques spammy.

Hier soir, au SMX Advanced de Seattle, Matt Cutts a annoncé que l’algorithme Payday Loan 3.0 devrait être déployé aujourd’hui. Cet algorithme visant les requêtes particulièrement spammy en sera à sa troisième mise à jour.

Dans le milieu du référencement, on connait surtout les filtres Google Panda et Google Penguin, visant respectivement les sites à pauvre contenu et les fermes de liens. Dorénavant, il faudra également compter sur l’algorithme Payday Loan, un filtre de Google visant à pénaliser les requêtes spammy sur le moteur de recherche.

Pour rappel, Google avait lancé une première version de Google Payday Loan au mois de juin 2013 puis avait déployé une seconde mise à jour il y a seulement quelques semaines puisque c’était au milieu du mois de mai 2014.

La différence entre Payday Loan 2.0 et Payday Loan 3.0

Lors de son intervention au SMX Advanced de Seattle, Matt Cutts a expliqué que les deux dernières mises à jour de Google Payday Loan ne visait pas le même objectif. En effet, la version 2.0 avait pour but de cibler les sites spammy alors que la version 3.0 visait les requêtes spammy.

Dès aujourd’hui, il se pourrait donc très bien que des mouvements soient visibles sur les requêtes de type [casinos], [viagra], [prêt sur salaire], etc.

Jusqu’à présent, Matt Cutts n’a pas vraiment clarifié la différence entre les sites et les requêtes spammy. Est-ce que l’un et l’autre ne sont pas intimement liés ? Nous y reviendrons dès que Matt Cutts donnera plus d’informations sur le sujet 😉

Découvrez ici toutes les mises à jour de l’algorithme Payday Loan !

Comme tous les lundis, nous vous proposons sur notre blog une infographie différente concernant les différents services que nous proposons. Il peut donc s’agir d’une infographie sur les médias sociaux, sur le référencement via des campagnes AdWords, sur l’importance de l’optimisation mobile ou encore sur le référencement naturel.

Comme tous les lundis, nous vous proposons sur notre blog une infographie différente concernant les différents services que nous proposons. Il peut donc s’agir d’une infographie sur les médias sociaux, sur le référencement via des campagnes AdWords, sur l’importance de l’optimisation mobile ou encore sur le référencement naturel.

Aujourd’hui, l’infographie que vous trouverez ci-dessous se rapporte à la thématique du référencement naturel, une pratique qui évolue sans cesse au fur et à mesure que Google intègre de nouveaux filtres et de nouveaux algorithmes dans son moteur de recherche. D’ailleurs, certains spécialistes n’hésitent pas à annoncer dès aujourd’hui qu’une prochaine mise à jour devrait avoir lieu avant la fin du mois (mais c’est à vous de vous faire votre propre opinion).

Comme on le disait, le référencement naturel a profondément évolué ces dernières années et certaines techniques qui pouvaient encore être efficaces il y a quelques années sont aujourd’hui pénalisées par le moteur de recherche. Parmi ces pratiques qui ont dû évoluer , on trouve les stratégies de link building.

Aujourd’hui, il faut privilégier le caractère naturel de ses liens et éviter les spams, les ancres de liens identiques ou encore les liens sur-optimisés. Pour en découvrir davantage sur ce qu’il faut faire et ce qu’il est préférable d’éviter, nous vous proposons de lire cette infographie proposée par GreenPal :